Jean SAGAUT

AI ACCESS

BP 331 91940

LES ULIS

Tél. : 01 64 46 54 09

E-mail : aiaccess@aol.com

Data Mining

- Les données de l’entreprise sont inexploitables par le cerveau humain (volume, nombre de variables).

- Pourtant, elles contiennent implicitement des informations d’une grande valeur pour l’entreprise.

DATA MINING : ensemble des processus qui permettent d’extraire de l’information à partir de données historiques de la vie de l’entreprise.

Le Data Mining

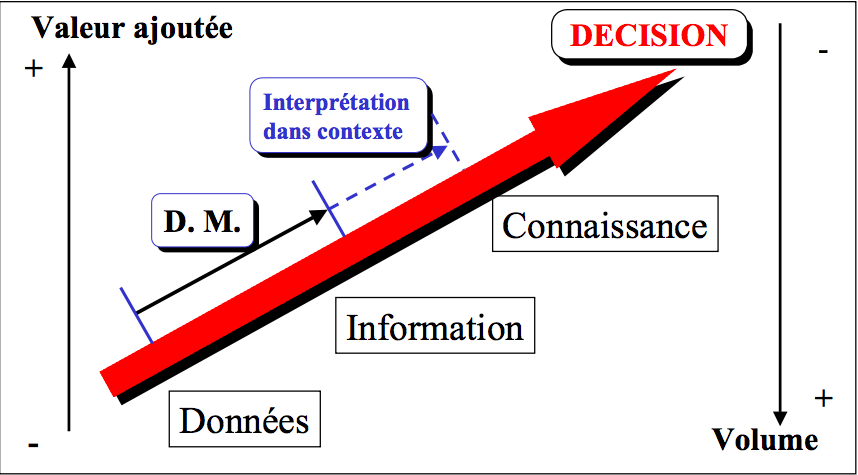

Information et connaissance

L’information est une représentation condensée (et souvent numérique) de données volumineuses :

- Le revenu moyen de nos clients est de 200KF.

- Plus de la moitié de nos clients ont moins de 30 ans.

La connaissance va plus loin. Elle interprète l’information en termes « métier » grâce au contexte :

- Notre nouveau produit financier attire les cadres en milieu de carrière qui changent souvent d’entreprise.

D. M. et connaissance

- La connaissance a plus de valeur que la simple information, mais elle nécessite un « effort de réflexion » supplémentaire.

- Le Data Mining a pour ambition de générer plus ou moins automatiquement de l’information à partir de données. Peut-il aller jusqu’à interpréter cette information, et la transformer en connaissance ?

Modélisation et interprétation

D.M. et modèles

Le Data Mining crée des modèles des données.

Un modèle est une machine à répondre à une question :

- Ce profil de conducteur achètera-t-il une motorisation standard, une injection, ou un diesel ?

- Quel budget ce profil de vacancier consacrera-t-il à ses prochaines vacances ?

- Quels sont les quelques profils-types de la population de mes clients ?

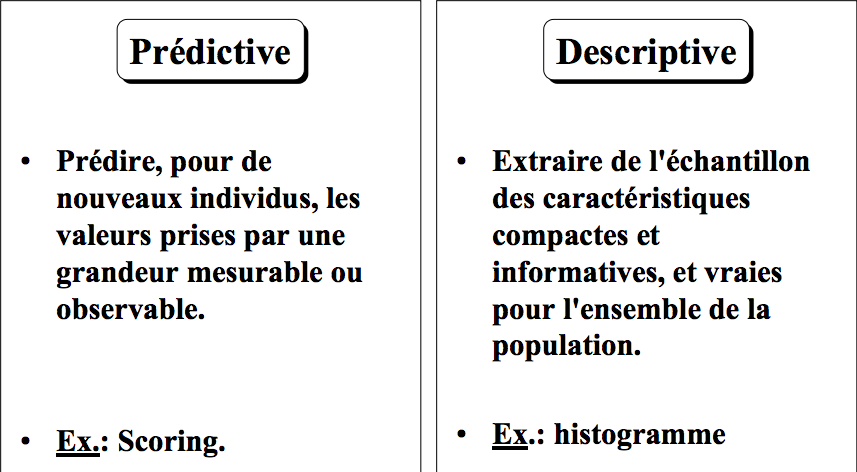

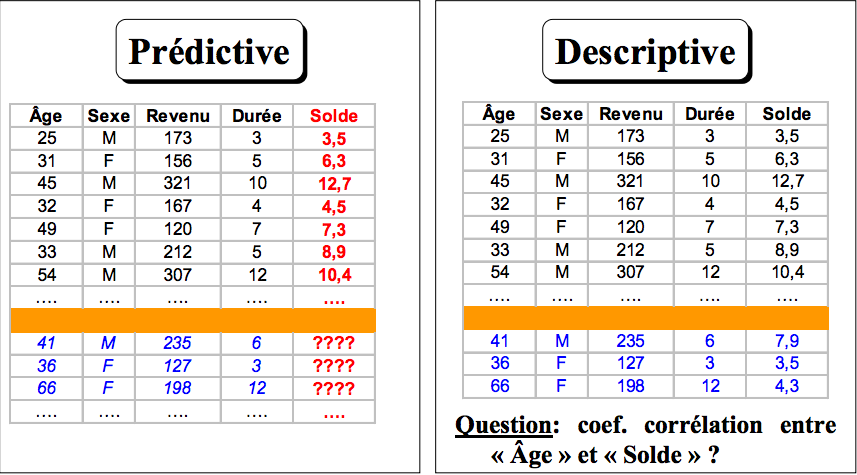

Les deux modélisations

Les deux modélisations (2)

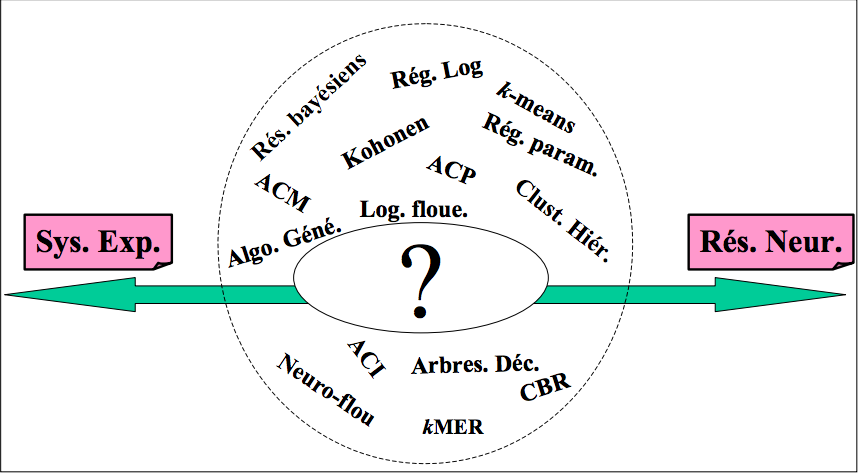

« Expert » ou « Oracle » ?

Un modèle peut avoir deux comportements extrêmes :

1) Il répond en termes directement interprétables par un spécialiste métier. Il se comporte comme un expert intelligent.

- Systèmes Experts.

2) Il répond sans que l’on soit capable d’interpréter facilement cette réponse.

- Réseaux de Neurones.

Galaxie des techniques !

Critères de choix

Nombreux critères de choix :

- Interprétabilité.

- Précision (accessible).

- Temps de calcul.

- Compétence.

- Maintenance.

- …

L’interprétabilité des modèles n’est qu’un critère de choix parmi d’autres.

Interprétabilité coûteuse

L’interprétabilité n’est jamais obtenue gratuitement. Il y a toujours un prix à payer :

- 1) Soit une diminution de la précision accessible au modèle.

- 2) Soit une augmentation de la difficulté d’élaboration du modèle

L’interprétabilité ne peut être exigée en soi. Il faut préciser ce que l’on est prêt à payer pour quel degré d’interprétabilité.

Le compromis Précision / Interprétabilité en modélisation prédictive

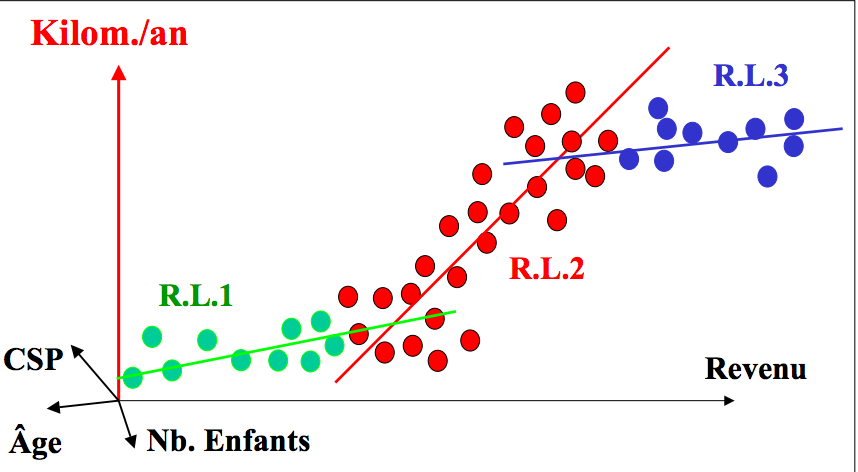

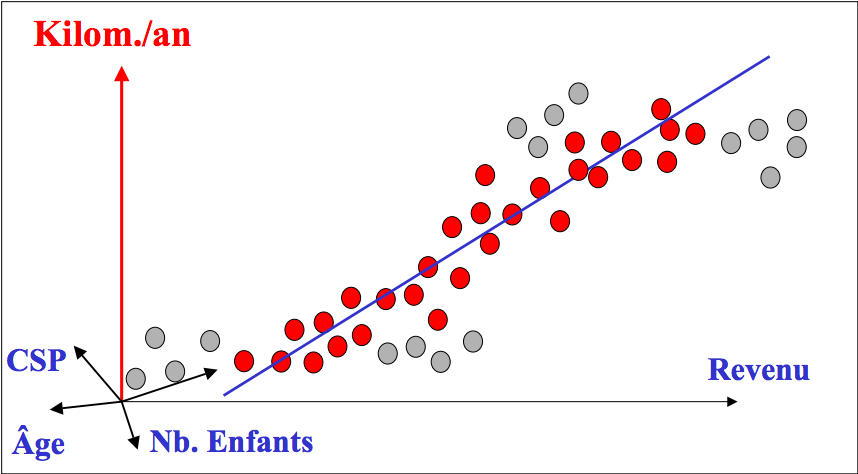

Régression linéaire

La R.L. est interprétable

Résultat de la R.L. : équation.

Km = -1000 + 500*âge + Ö+0,3*Revenu

Interprétation :

Toutes choses égales par ailleurs, le kilométrage annuel augmente en moyenne de 500km quand l’âge du conducteur augmente de 1 an.

Mais le modèle est manifestement peu précis.

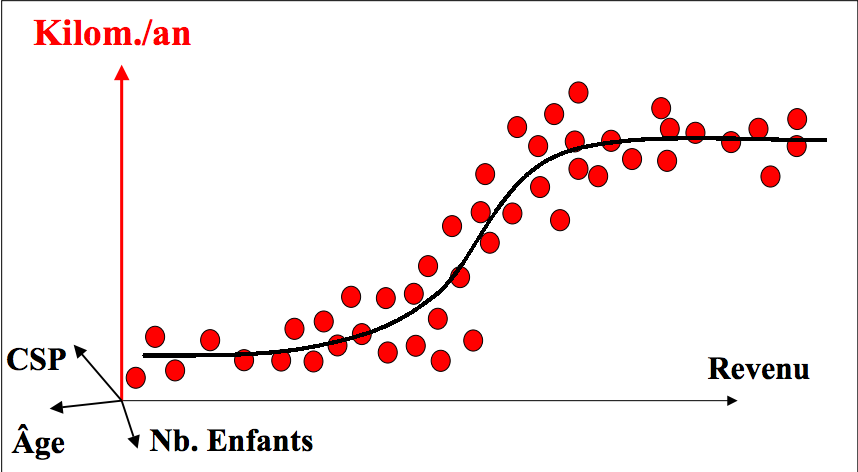

Règ. Non linéaire

Améliorations envisageables de la précision :

- Régression linéaire par morceaux.

- Splines, polynômes.

- Réseaux de Neurones.

Aucune de ces méthodes ne pourra à la fois :

- Améliorer la précision accessible

- Conserver l’interprétabilité.

- Conserver la fiabilité du modèle

Règ. Lin. par morceaux (1)

Règ. Lin. par morceaux (2)

Le modèle est apparemment plus précis que le précédent.

Interprétabilité conservée :

Si Conditions(1) alors RÈg _ Lin(1).

Si Conditions(2) alors RÈg _ Lin(2).

Si Conditions(3) alors RÈg _ Lin(3).

La partie est-elle gagnée ?

Règ. Lin. par morceaux (3)

MAIS :

- Chacune des régressions n’est construite que sur un nombre de points réduit.

- Ceci rend chacun des sous-modèles beaucoup plus incertain que le modèle de régression linéaire simple.

- Le modèle a perdu en crédibilité.

Polynômes ?

On peut améliorer la précision apparente en utilisant un polynôme de degré supérieur à 1.

Km/an = a + Ö + k*âge*Revenu + …

Mais : Solution hasardeuse :

- On montre que les modèles polynomiaux sont entachés de grandes incertitudes.

Comment interpréter k ??

Réseaux de neurones ? (1)

Réseaux de neurones ? (2)

Les Réseaux de Neurones sont les modèles qui donnent les meilleurs résultats.

Mais :

- Construction délicate.

- Temps de calcul importants.

- Peu interprétables.

Les R.N. sont des « boîtes (presque) noires ».

« Juste milieu »

- Le compromis entre : Précision accessible par le modèle, interprétabilité du modèle, est très général.

- Certaines techniques cherchent un juste milieu.

Exemple : Arbres de Décision.

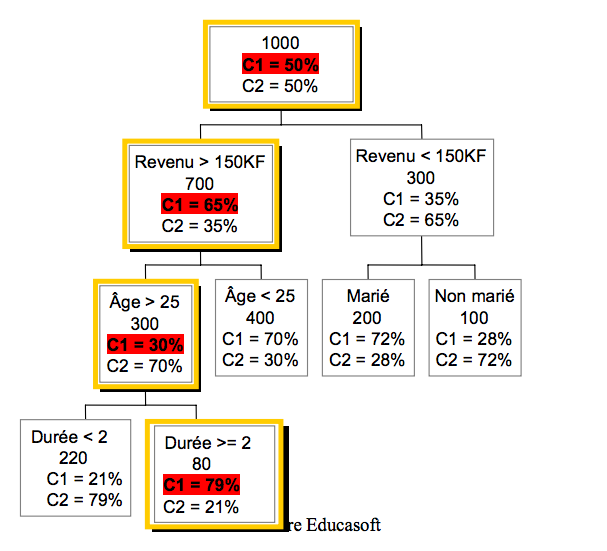

Arbres de Décision

A.D. et interprétabilité

Le chemin mis en évidence conduit à la règle :

SI (Revenu > 150) ET (âge > 25) ET (Durée > 2 ans)

ALORS Probabilité_OK = 79%

Les Arbres de Décision produisent donc des décisions interprétables.

Solution miracle ?

Limites des A.D.

Les règles sont d’une utilité limitée :

- Trop nombreuses, car trop rustiques.

- Trop incertaines si poussées jusqu’aux feuilles (petites populations).

- Trop imprécises.

Ce dernier point demande à être expliqué : il constitue la limite fondamentale des Arbres de Décision.

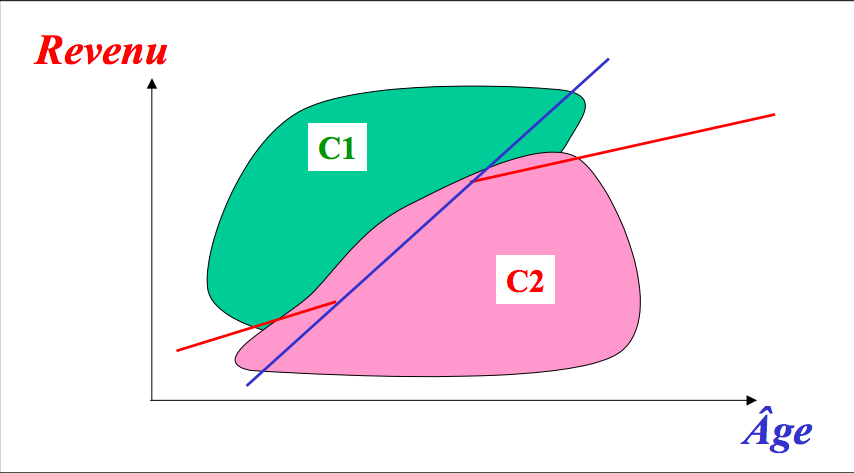

Frontières // axes

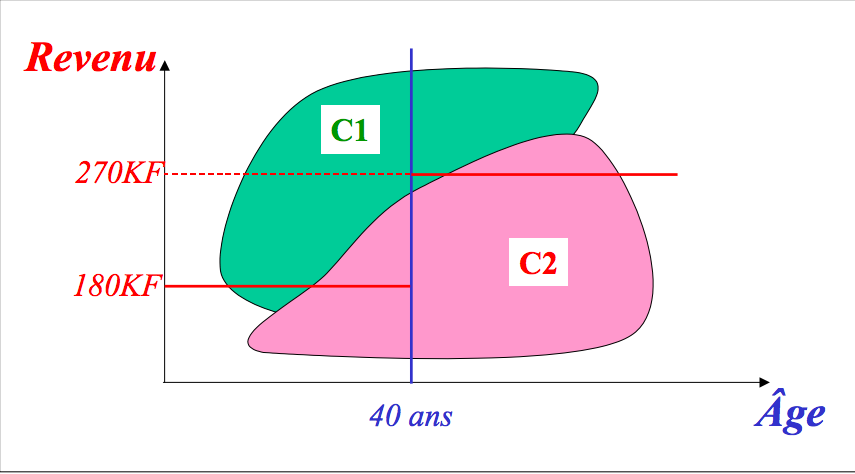

Frontières parallèles

Les frontières sont des hyperplans parallèles aux axes.

Ces frontières rigides sont la cause de :

- Précision des prédictions médiocre.

- Faible interprétabilité des règles.

- Mais aussi de la rapidité des A.D..

Peut-on améliorer ?

Frontières « en biais »?

Au delà des variables isolées ?

Frontières comme combinaisons linéaires des variables prises par paires ?

Le nombre de choix possibles augmente très vite : temps de calcul importants.

- Interprétabilité??

SI (1,22*Revenu – 0,44*âge) > 250 ET etc.

- Interprétation ???

Le compromis Précision / Interprétabilité en modélisation descriptive

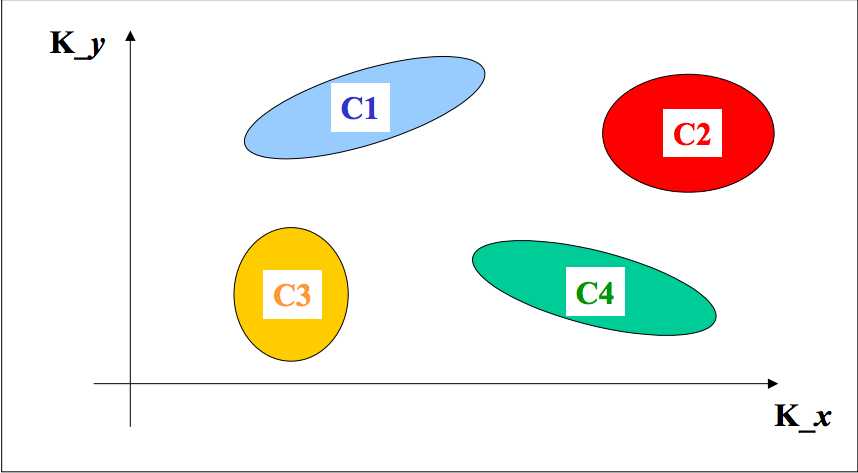

M. D. et compression

Modélisation descriptive :

- Mille et une manières de compresser des données (avec pertes) pour en extraire du sens (interprétation).

Exemples classiques :

- Clusterisation (regroupement, typologie) : Réduit le nombre d’enregistrements.

- Réduction de dimensionnalité : Réduit le nombre de champs.

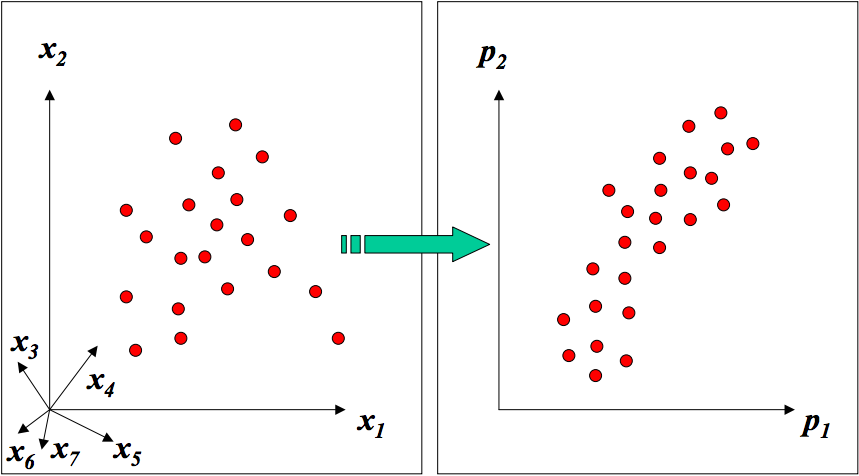

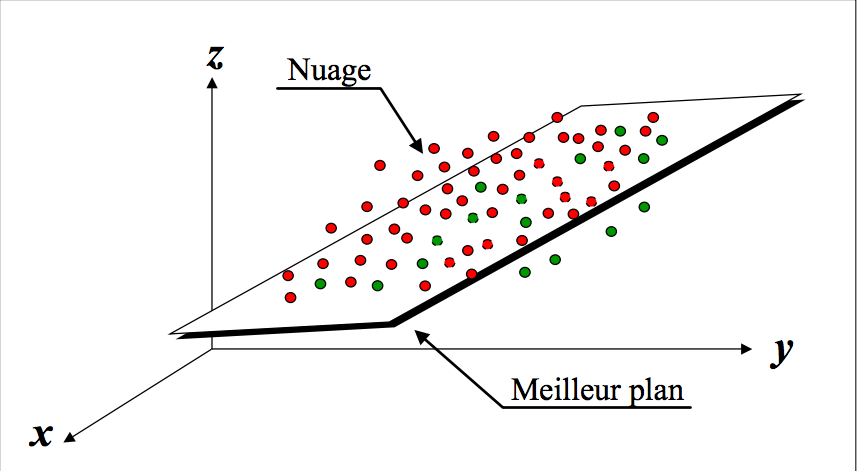

Réduction de dimensionalité

ACP

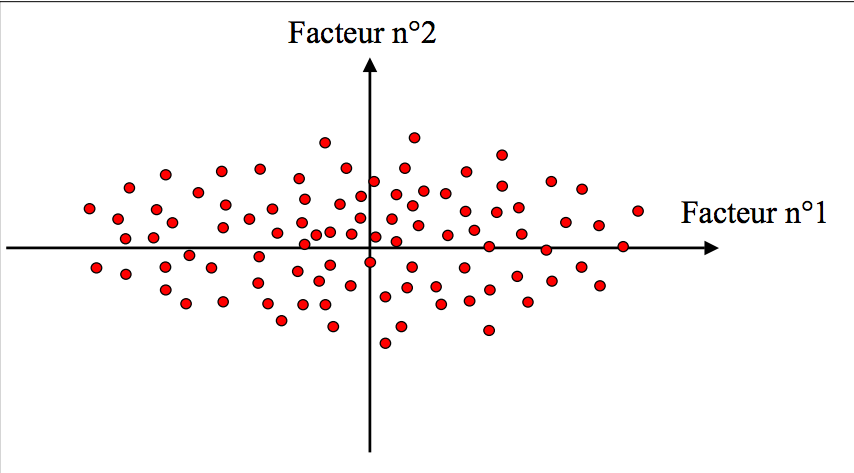

Axes factoriels

ACP et interprétation

Interprétation d’une ACP :

- 1) Nombre de composantes principales significatives.

A peu de choses près, de combien de vraies variables ai-je besoin pour d’écrire mes données ?

- 2) Interprétation des axes factoriels.

Ex.: L’axe factoriel n°1 oppose les comptes à faible montant moyen et transactions fréquentes, aux comptes largement approvisionnés et aux transactions rares.

- 3) Interprétation de la position des individus sur les plans factoriels + typologie.

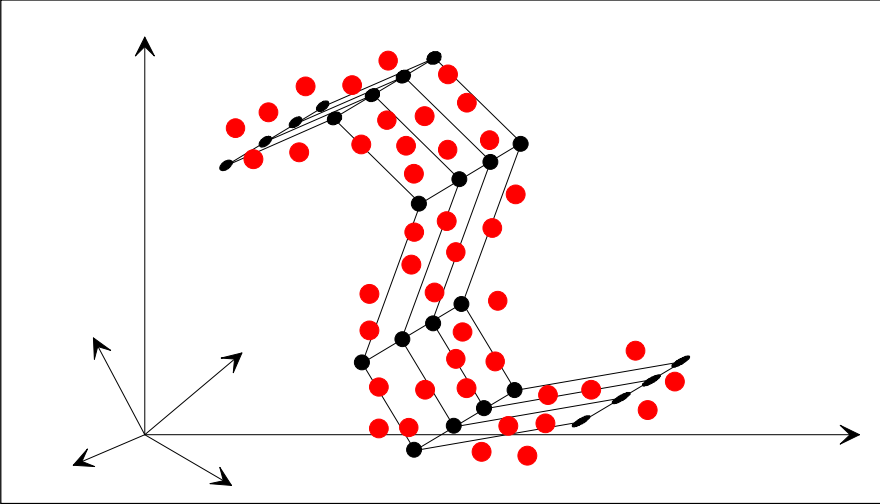

Cartes de Kohonen

Interprétation de Kohonen ?

Ont disparu :

- Les valeurs propres !

- Les axes factoriels !

Mais :

- Représentation plus fidèle des données.

- Clusterisation plus franche des données, et donc mieux interprétable.

- Proximité naturelle des clusters (Cartes topologiques).

K. et typologie

Conclusions

Interprétabilité

- Interrogez-vous sur la nécessité d’obtenir des modèles interprétables.

A quoi me sert l’interprétabilité ?

- Quel est le coût économique de cette interprétabilité?

Soyez prêt à envisager un compromis pour gagner en précision.

(Non)-interprétables ?

Les modèles interprétables sont souvent décevants par :

- Leur faible précision.

- Leurs incertitudes (Petites feuilles de A.D.).

Les modèles non interprétables (R.N.) disposent en fait de nombreuses aides à l’interprétation :

- Identification des extrêma.

- Visualisation.

- Analyse des sensibilités.

L’aphorisme du jour !

- Cette problématique « précision-interprétabilité » entre dans le cadre plus général de la définition des besoins.

- C’est cette définition qui doit permettre d’identifier la technique appropriée.

On peut faire entrer une vis dans un mur avec un marteau. Mais à quel prix ?